Quelques centaines de millisecondes. C'est la différence entre un utilisateur qui reste et un utilisateur qui part. C'est aussi la différence entre un serveur qui tourne à plein régime inutilement et un serveur qui respire. Mettre en place un cache HTTP avec Varnish, c'est une décision technique simple en apparence mais dont l'impact se mesure simultanément sur l'expérience utilisateur, le référencement naturel et la sobriété numérique de votre dispositif.

Varnish Cache est un reverse-proxy HTTP open source. Concrètement, il s'installe en amont de votre serveur web et intercepte les requêtes des visiteurs avant qu'elles n'atteignent votre CMS ou votre application. Si la page demandée a déjà été générée et mise en cache, Varnish la sert instantanément, sans déclencher le moindre appel PHP, aucune requête SQL, aucun rendu CMS.

Le résultat est immédiat : on observe couramment des réductions de temps de réponse de 80 à 95 % sur les pages les plus consultées. Une page qui met 800 ms à s'afficher peut descendre sous les 30 ms une fois le cache chaud. Le serveur, lui, ne reçoit plus qu'une fraction des requêtes qu'il traiterait normalement, libérant des ressources pour les pics de charge et réduisant sa consommation énergétique à la source.

Varnish fonctionne à son maximum sur les sites dont le contenu est identique pour tous les visiteurs et change peu dans le temps. Ce sont typiquement :

Pour les sites e-commerce (PrestaShop, Sylius, WooCommerce) ou les portails connectés avec espaces personnalisés, le cache Varnish est techniquement possible mais le ratio effort / bénéfice est plus complexe à équilibrer. Il faut définir finement quelles URLs sont cachables (pages catalogue, contenu éditorial) et lesquelles doivent systématiquement bypasser le cache (panier, compte client, stock en temps réel, contenus géolocalisés). La configuration VCL devient plus chirurgicale, et l'invalidation doit être orchestrée avec précision. Ce n'est pas une impossibilité, c'est une question de périmètre et d'arbitrage.

À retenir : La majorité des sites CMS sont éligibles à une implémentation rapide et directement bénéfique. Les projets plus connectés méritent une analyse de périmètre avant de se lancer pour cibler le bon combo d'outils de caches.

C'est là que la différence se joue. Installer Varnish sur un serveur brut prend quelques heures. Le configurer correctement pour qu'il serve votre projet sans créer de régressions ni de contenus obsolètes c'est un travail d'artisan qui demande de maîtriser l'ensemble de la chaîne.

Le langage de configuration de Varnish (VCL) permet de définir avec précision les règles de mise en cache : quelles URLs, quels cookies, quels headers HTTP déclenchent ou non la mise en cache. Chez Digital Garden, nous développons des gabarits VCL par famille de CMS (un gabarit WordPress, un gabarit Drupal, un gabarit Prestashop, etc..) qui gèrent nativement les cas spécifiques à chaque plateforme : contournement de la zone d'administration, gestion des cookies d'authentification, durées de vie différenciées selon le type de contenu.

Le cache n'a de valeur que s'il est fiable. Sur WordPress, nous intégrons des modules comme Proxy Cache Purge qui déclenchent automatiquement l'invalidation des pages concernées dès qu'un éditeur publie ou modifie un contenu. Sur Drupal, le système de cache-tags natif permet une invalidation chirurgicale : modifier un bloc ne purgera que les pages qui l'affichent réellement, pas l'ensemble du cache. Le contributeur continue à travailler normalement et le cache se gère de façon transparente.

Chaque déploiement applicatif peut invalider une partie ou la totalité du cache. Nous intégrons cette logique directement dans les pipelines CI/CD (Bitbucket, GitHub Actions) : une étape de purge Varnish est déclenchée automatiquement à chaque mise en production, garantissant que les utilisateurs ne voient jamais un contenu obsolète après une livraison.

Mettre en place Varnish sans mesurer son impact réel, ce serait passer à côté de l'essentiel. Nous réalisons des benchmarks de performance avant et après déploiement (Time To First Byte, taux de cache hit, réduction des requêtes serveur) et assurons un suivi des métriques dans le temps via notre infrastructure de monitoring. Si le taux de cache hit chute sans raison apparente, on le sait avant que ça ne devienne un problème.

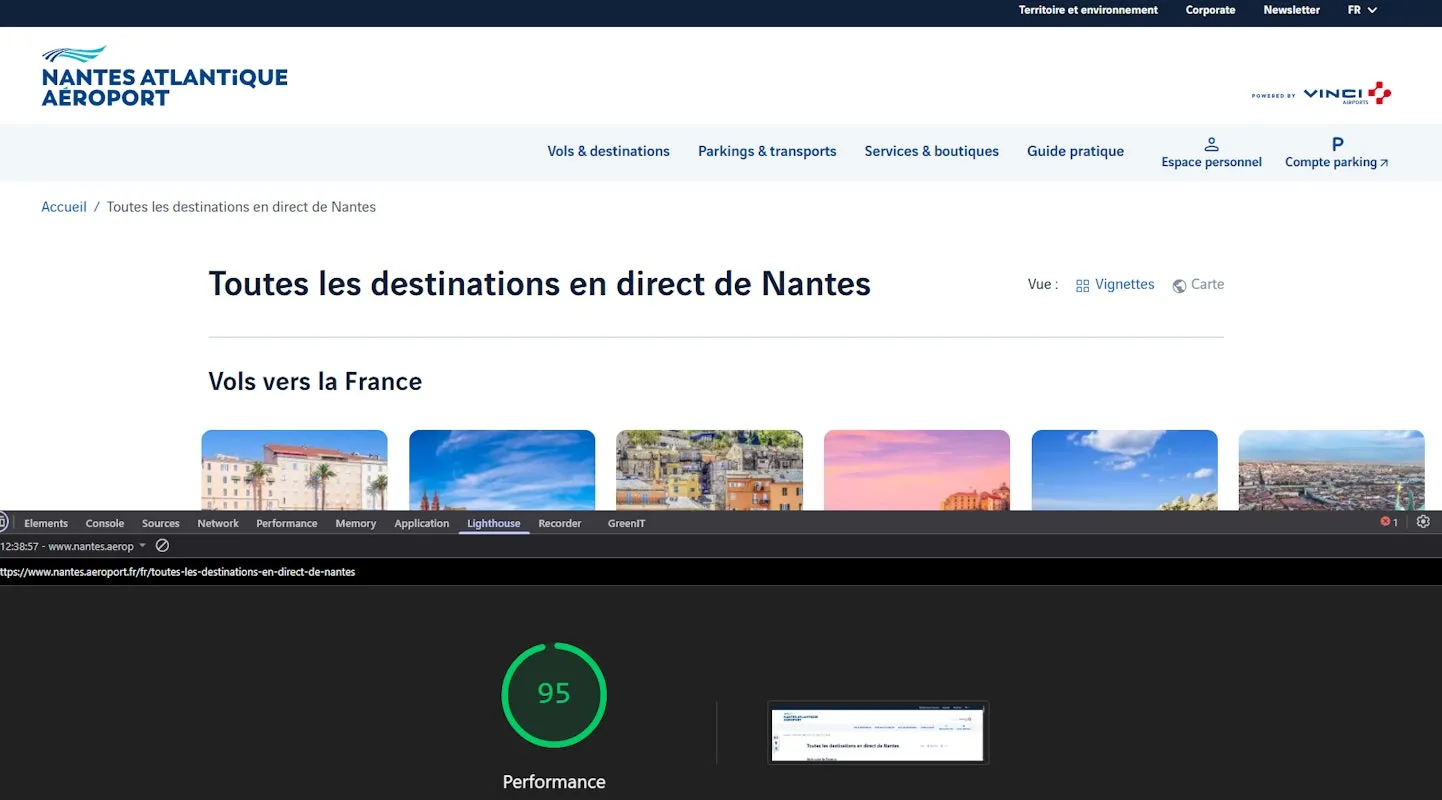

Parmi les projets que nous hébergeons et que nous pilotons, la plateforme de l'Aéroport de Nantes illustre concrètement ce que peut apporter une implémentation soignée de Varnish sur un site Drupal à fort trafic. Le contexte est exigeant : une plateforme institutionnelle avec des pics de consultation marqués (ouverture de saison, annonces de liaisons, météo, informations de vol), une nécessité de fraîcheur de l'information, et des attentes élevées côté performance.

Grâce à une configuration Varnish calibrée pour Drupal avec invalidation par cache-tags, grace mode activé pour absorber les pics, et TTL différenciés selon la nature des contenus — le site affiche des temps de réponse qui se comptent en dizaines de millisecondes sur les pages les plus visitées. Le serveur, lui, absorbe les pics de charge sans broncher parce qu'il n'est sollicité qu'une fraction de ce qu'il devrait l'être sans le cache.

C'est le type de résultat qu'on vise systématiquement. Pas une magie noire réservée aux grandes plateformes : une ingénierie appliquée, documentée, reproductible.

La performance d'un site web a longtemps été pensée uniquement côté utilisateur. Elle a aussi une dimension environnementale directe, trop souvent négligée.

Chaque requête qui atteint un serveur applicatif consomme de l'énergie : cycle CPU, accès disque, exécution PHP, requêtes base de données. Sur un site sans cache, chaque visiteur de chaque page déclenche ce cycle complet avec des dizaines ou centaines de fois par minute, des milliers de fois par jour. Varnish rompt ce cycle pour toutes les requêtes que le cache peut servir seul.

Concrètement, on observe des réductions de charge serveur de l'ordre de 70 à 85 % sur les sites bien configurés. Ce n'est pas anecdotique : c'est une action directe sur la consommation énergétique de votre infrastructure, quantifiable, documentable et valorisable dans votre reporting RSE ou vos démarches d'éco-conception numérique (RGESN).

Nous hébergeons notre infrastructure chez Scaleway, dont les datacenters affichent un PUE de 1,15 et sont référencés par la Green Web Foundation. Optimiser les appels applicatifs au-dessus d'une infrastructure déjà sobre, c'est démultiplier l'effort. Moins de requêtes serveur, moins d'énergie consommée, même trafic utilisateur et souvent même expérience améliorée.

Pour la grande majorité des sites CMS que nous hébergeons, la mise en place de Varnish représente entre 2 et 4 jours de travail avec la configuration serveur, VCL, tests de régression, intégration CI/CD, back-office ou batchs de l'applicatif web et validation des métriques. C'est un chantier que l'on peut qualifier rapidement et livrer en quelques semaines.

En face de cet investissement : un gain de performance immédiatement mesurable (TTFB divisé par 5 à 20 sur les pages en cache), une meilleure capacité à absorber les pics de trafic, une amélioration potentielle des scores Core Web Vitals et du référencement organique, et une réduction durable de la charge serveur. Sur la durée d'un contrat d'hébergement, le retour sur investissement est structurellement positif.

Varnish n'est pas la seule brique d'une stratégie de performance solide. Selon votre contexte, nous pouvons l'associer à d'autres leviers complémentaires : WAF (pare-feu applicatif) pour la sécurité, CDN pour la distribution géographique du contenu statique, Redis pour les données chaudes, optimisation des assets (compression, lazy loading, WebP), ou revue d'architecture applicative pour les projets plus complexes.

Notre équipe Hosting & DevOps accompagne cette réflexion de bout en bout : du diagnostic initial à la mise en production, en passant par la documentation et le suivi des métriques dans le temps. Pas de formule magique : une analyse de votre site, une configuration adaptée à votre CMS et à vos enjeux, et des mesures pour vérifier que ça fonctionne vraiment.

Votre site est hébergé chez nous et vous vous posez la question ? Parlons-en directement.